2月4日,第35届人工智能国际会议AAAI在线召开,在开幕式上,组委会揭晓了本届会议最佳论文奖(Best Paper Award),共三篇论文入选,其中首篇最佳论文由北京航空航天大学计算机学院、北京航空航天大学大数据与脑机智能高精尖创新中心博士生周号益(第一作者)、彭杰奇、张帅和李建欣教授(通讯作者)联合UC Berkeley大学仉尚航博士、Rutgers大学熊辉教授等团队所斩获,论文题目为《Informer: Beyond Efficient Transformer for Long Sequence Time-Series Forecasting》。AAAI是世界人工智能领域最顶尖的国际学术会议之一,本届会议提交论文数量达到9034篇,再次创下投稿量历史新高。这是中国大陆42年来第二次、时隔近十年再次获得人工智能领域顶级会议AAAI最佳论文奖项。同时,北航计算机学院硕士生郝雅茹和指导教师许可教授联合微软亚洲研究院董力、韦福如完成的论文“Self-Attention Attribution:Interpreting Information interactions inside transformer”获得AAAI最佳论文Runners Up奖。

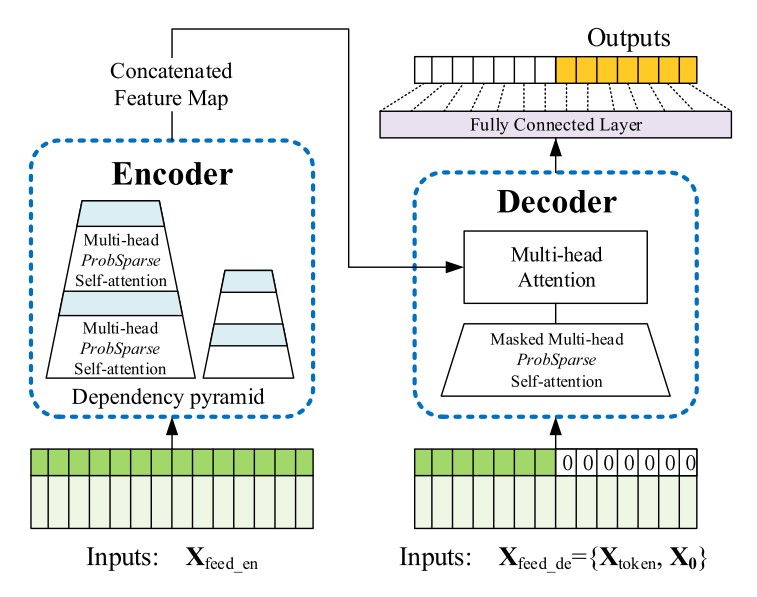

图1 面向长序列数据的Informer网络结构示意图。

长时间序列分析预测一直是人工智能基础理论研究的难点,对工业健康维护、疾病传播预测、网络安全分析等关键领域具有重要作用。获奖论文指出“传统循环神经网络因误差逐层累积”已不能满足长序列数据分析的需求,并首次明确了Transformer神经网络架构对长序列问题建模的重要意义。该架构的核心优势是构建了自注意力机制来捕捉跨长度的前后相关性,但其伴随的重大挑战是自注意力操作具有随输入长度的二次时间复杂度,无法适用于长序列输入和输出。据此,该论文突破了传统自注意力的计算复杂度限制,提出一种全新的从概率角度进行自注意力矩阵稀疏化的模型ProbSparse Attention。该模型可以允许以非启发式的方式对自注意力计算进行长尾显著性分析,摘取长序列中重要的前后相关性对,可以依采样方案将计算复杂度降低至对数线性复杂度,令ProbSparse自注意力满足长序列分析的建模要求。同时,该论文还提出了注意力蒸馏机制来允许构建更深的长序列堆叠模型,同时通过生成式解码来实现长序列单次前向输出。这是首次在长序列问题上运用Transformer神经网络架构,依靠所提出的可分析稀疏化、注意力蒸馏和生成式解码组成Informer网络结构,可以在同样硬件限制下显著提高序列分析任务性能,为解决长序列问题提供了一种全新的解决方案。

北航计算机学院博士生周号益一直致力于人工智能理论与应用研究,解决工业、医疗等行业中真实问题。该同学与国家电网等合作,所研发设备故障预测算法在山东等省份应用,监测范围覆盖1300余座110kV~500kV超高压核心变压器,辅助研判重型设备负载下工况,保障重大固定资产安全;与陈天宇等同学参加2020年工业和信息化部“全国工业APP和信息消费大赛”获得一等奖,大赛共有包括中船重工、中国一汽、科大讯飞等2310支队伍参赛。与北京大学第三医院、北京大学肿瘤医院、北京天坛医院等持续合作,基于时空序列方法建立慢阻肺加重等预警模式,联合项目于2019年获评北京市“首都转化医学创新大赛”优秀奖。2020年,周号益作为学生负责人参与高精尖创新中心的新冠疫情大数据防控分析任务,国家卫健委传染病智慧化多点触发监测预警平台规划和试点验证等工作,支撑国家疫情防控决策,得到了国务院办公厅、北京市卫健委等专函致谢。

北京航空航天大学大数据与脑机智能高精尖创新中心:首批北京高校高精尖创新中心之一,该中心旨在围绕复杂大数据可计算、群体智能可学习、多态跨域知识可关联等科学问题,开创面向脑智能的数据科学、智能科学、认知科学三大研究方向,创建以数据建模、群智学习、知识图谱为重点的大数据科学理论体系,研制自组织、自适应、自生长的脑机智能技术系统,创造以脑机智能为核心的“机器脑”和“社会脑”,从而把中心建设成为国际一流的大数据科学与脑机智能创新研究高地和人才汇聚中心。(http://bdbc.buaa.edu.cn/)